Memahami Backpressure: Seni Mencegah Server Tumbang Saat Traffic Membludak

Catatan belajar tentang apa itu backpressure dan strategi jitu menangani lonjakan traffic agar server tidak tumbang.

Daftar Isi

Share Article

Pendahuluan

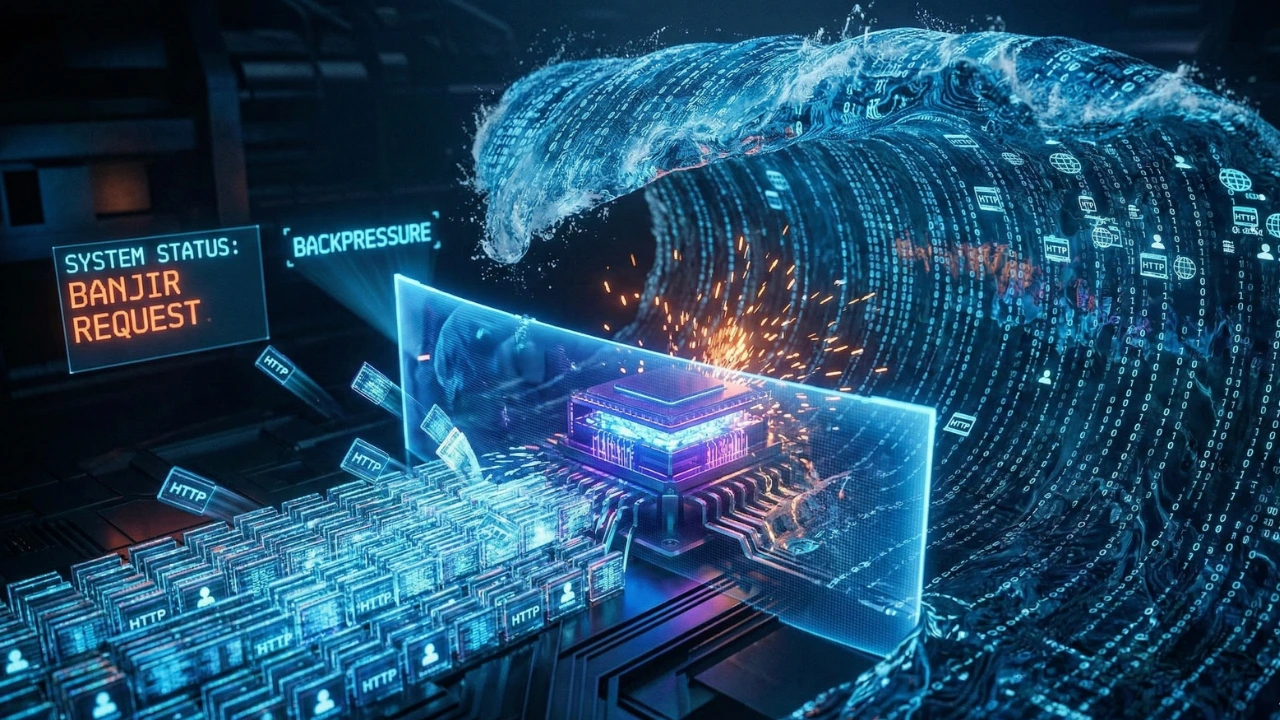

Bayangkan aplikasi kita baru rilis fitur baru atau sedang mengadakan event flash sale. Awalnya semua berjalan lancar dan traffic stabil tanpa kendala sedikit pun. Tiba-tiba, ribuan user mengakses bersamaan dan server langsung tumbang seketika.

Momen seperti ini pasti bikin jantungan dan panik tim developer. Seringkali kita langsung mengecek apakah ada kode yang error atau query database yang salah. Padahal, sistem bisa hancur murni karena terlalu laris dan kebanjiran request.

Masalah yang Ingin Diselesaikan

Kondisi di mana request masuk jauh lebih cepat daripada kemampuan server memprosesnya ini sangat berbahaya. Aplikasi dipaksa bekerja di luar batas kapasitas maksimalnya. Jika dibiarkan, memori server akan habis hanya untuk menahan antrean request yang masuk.

Ujung-ujungnya, aplikasi terkena error Out of Memory (OOM) dan mati total. User yang tidak sabar biasanya akan terus melakukan refresh halaman. Hal ini justru membuat beban server berlipat ganda bak bola salju yang menggelinding.

Konsep Dasar

Dalam dunia engineering, kondisi "tersedak" ini dikenal dengan istilah Backpressure. Anggaplah sistem backend kita itu sebuah corong air dengan kapasitas maksimal 50 liter per detik. Lalu tiba-tiba corong tersebut diguyur air sebanyak 100 liter per detik dari atas.

Sisa 50 liter air tersebut tidak bisa langsung masuk dan akhirnya menggenang di atas corong. Makin lama diguyur, genangan makin tinggi dan air akan tumpah ke mana-mana. Begitulah gambaran request klien yang membeludak dan menumpuk di antrean memori server kita.

Gambaran Arsitektur

Salah satu solusi paling elegan untuk meredam backpressure adalah menggunakan Message Broker. Broker bertindak sebagai bantalan (buffer) raksasa yang menampung request klien. Berikut adalah gambaran arsitektur Event-Driven sederhana:

[ Traffic Membludak dari Client ]

|

v

+-----------------------------+

| API Gateway | ---> Langsung kembalikan respons "Diproses" ke Client

+-----------------------------+

|

v (Menyimpan data ke antrean)

+-----------------------------+

| Message Broker (Kafka/dll) | ---> Antrean raksasa yang aman dari OOM

+-----------------------------+

|

v (Diambil perlahan sesuai kapasitas)

+-----------------------------+

| Backend Worker | ---> Memproses data tanpa panik

+-----------------------------+

Implementasi & Strategi Penanganan

Ada banyak strategi, mulai dari menambah jumlah pekerja (Horizontal Scaling) hingga membuat antrean (Queue). Namun, jika budget terbatas dan lonjakan sangat ekstrem, menolak request (Rate Limiting) adalah langkah darurat yang wajib ada. Lebih baik menolak sebagian pengguna daripada server mati dan semua orang tidak bisa bertransaksi.

Kesalahan Umum

Kesalahan yang paling sering terjadi adalah hanya memperbesar nilai timeout di server. Menaikkan timeout dari 30 detik menjadi 2 menit seolah menyelesaikan masalah, padahal tidak. Ini cuma menunda bencana, karena user tetap disuruh menunggu layar loading yang tak kunjung usai.

Selain itu, mengandalkan scaling up (menambah RAM/CPU) secara membabi buta juga bukan solusi jangka panjang. Akan selalu ada titik di mana resource fisik mentok atau tagihan cloud membengkak tak terkendali. Akar masalahnya (aliran traffic yang tidak terkontrol) tetap harus ditangani secara arsitektural.

Refleksi Developer

Awalnya saya lumayan bingung, kenapa server down tidak bisa selalu diselesaikan cuma dengan nambah spek VPS. Ternyata pemahaman saya salah, karena aplikasi yang laris manis tetap punya batas ambang batas komputasi. Saya jadi dapat insight baru bahwa arsitektur yang kuat itu justru tahu kapan harus berani bilang "tidak" (menolak request) kepada user.

Ke depannya, saya jadi makin penasaran untuk mengulik Message Broker seperti RabbitMQ. Pola pikir memisahkan penerimaan request dengan pemrosesan berat di belakang layar ini sangat menarik. Saya belajar bahwa menjadi engineer adalah tentang meracik trade-off yang paling pas dengan kondisi sistem kita.

Kesimpulan

Menangani backpressure adalah keterampilan wajib saat aplikasi mulai memiliki banyak pengguna. Inti dari optimasi ini bisa dirangkum dalam beberapa langkah praktis:

- Lakukan scaling (vertikal/horizontal) jika budget memungkinkan.

- Gunakan mekanisme antrean atau Message Broker agar sistem memproses sesuai kemampuannya.

- Terapkan Rate Limiting sebagai jaring pengaman terakhir agar server tidak tumbang total.

Tidak ada solusi ajaib yang gratis dalam merancang sistem. Semuanya kembali pada kebutuhan bisnis dan kesiapan infrastruktur kita.

Referensi

Backpressure - Senior Programmer Wajib Ngerti - Programmer Zaman Now